Fraude à la publication scientifique : le cas des « paper mills » et autres moulins à articles, revues et citations

Cet article est une compilation thématique de sources issues de publications relatives à a Science ouverte (open science) de l’Institut Pasteur sur ses évolutions, enjeux et pratiques

Les paper mills, review mills et citation mills : Avez-vous déjà entendu parler des paper mills, des fermes à articles ou encore des moulins à papiers ? Tous ces noms décrivent la même chose : des sociétés qui vendent de grandes quantités d’articles scientifiques frauduleux à des auteurs cherchant à augmenter leur nombre de publications pour obtenir une promotion ou un poste (un autre effet du fameux paradigme « Publish or Perish »).

Le paradigme « Publish or Perish » ou pourquoi l’utilisation du Facteur d’Impact et de l’Indice H dans l’évaluation pose problème

La revue Nature, en 1962, abordait déjà le problème du « Publish or Perish » dans une tribune du 24 février : ils déploraient le fait que les scientifiques soient poussés à publier pour obtenir de l’avancement et témoignaient déjà à l’époque du risque de « mauvaise » science que cela entrainait.

Aujourd’hui malheureusement ce constat est toujours d’actualité. On a même « amélioré le système » en s’appuyant sur des indicateurs chiffrés tels que le Facteur d’Impact des revues et l’Indice H du chercheur. Ces indicateurs sont encore régulièrement demandés lors des évaluations individuelles, bien qu’ils soient controversés.

Que reproche-t-on à ces 2 indicateurs ?

Le premier, le facteur d’Impact d’une revue n’est malheureusement pas corrélé à la « qualité » de la publication. En effet, ce n’est pas parce que l’on a une publication dans Science (revue avec un très fort facteur d’impact) que l’on a été cité et que la publication a un impact fort sur la recherche. Voilà pourquoi il a été demandé, lors de la Déclaration de San Francisco sur l’Evaluation de la Recherche (DORA), d’abandonner cet indicateur lors de l’évaluation individuelle des chercheurs.

Le deuxième indicateur incriminé est l’Indice H du nom de son inventeur Jorge Hirsch en 2005. Cet indice h est le nombre h d’articles cités au moins h fois. Il dépend donc de la durée de la carrière de la personne évaluée et ne tient pas compte des autres types de documents, des pratiques de publication du domaine ni de la place de l’auteur dans la liste des auteurs. Il a donc de forts biais. C’est pourquoi le Manifeste de Leiden recommande de ne pas l’utiliser.

Aujourd’hui, avec le mouvement de la Science Ouverte, une évaluation plus qualitative tente de se développer. Cette évaluation pourrait prendre en compte une plus grande diversité de documents mais aussi un plus grand nombre de types de contributions des chercheurs notamment en terme d’intégrité. On vous en parle davantage ici.

Les auteurs paient pour obtenir un article, généralement de mauvaise qualité, contenant de fausses données, des informations plagiées ou douteuses et parfois écrit par une intelligence artificielle. Ces « faux articles » peuvent ensuite être facilement publiés dans des revues prédatrices qui n’effectuent pas ou peu de révision par les pairs.

Les revues prédatrices

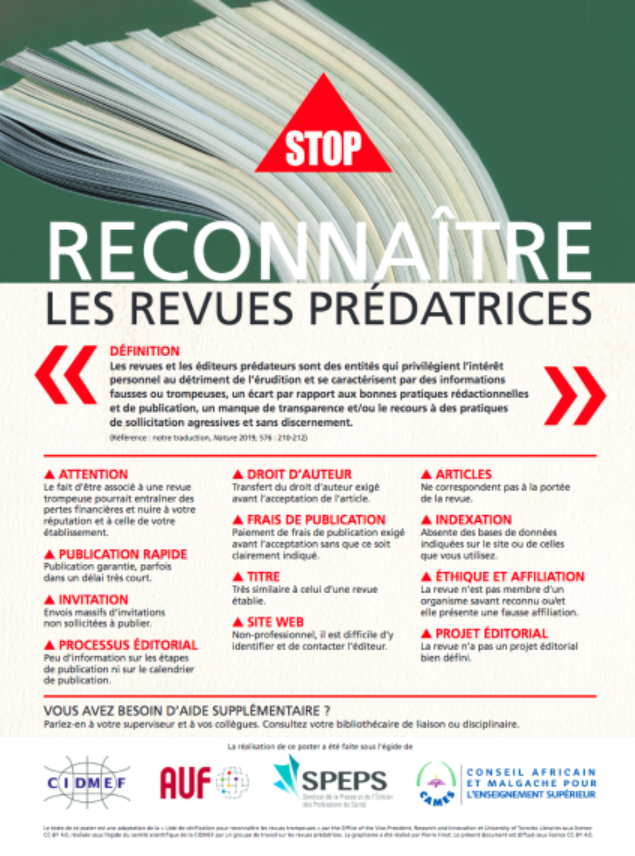

Une revue prédatrice est une revue frauduleuse qui prend la forme d’une revue scientifique mais est proposée par une entité qui privilégie l’intérêt personnel au détriment de la recherche.

Pourquoi « prédatrice » ? La méthode d’approche est explicite : suite à un envoi en masse de courriels vous offrant de publier vos articles (le plus souvent en libre accès), l’éditeur impose des frais de publications à payer avant acceptation pour, au final, des services éditoriaux (et révisions par les pairs) minimaux, voire inexistants.

Ci-dessous un poster réunissant les critères qu’il faut prendre en compte pour repérer une revue prédatrice.

L’accélération des paper mills

Depuis quelques temps, ces sociétés sont passées à la vitesse supérieure en corrompant des éditeurs de revues pour faire accepter leurs articles, comme le raconte Frederik Joelving de Retraction Watch dans un article publié dans Science en janvier 2024. Les paper mills paient des rédacteurs en chef pour qu’ils acceptent leurs articles rapidement ou pour placer leurs propres éditeurs ou reviewers dans les comités éditoriaux des journaux.

Ce mode de prédation est apparu en Chine où la pression à la publication (sans validation de la qualité) était très forte, puis s’est étendu en Inde, en Iran et diffuse petit à petit un peu partout dans le monde.

Deux autres modes de prédation émergent depuis peu, encore plus inquiétants peut-être, ce sont les « review mills » et les « citation mills » :

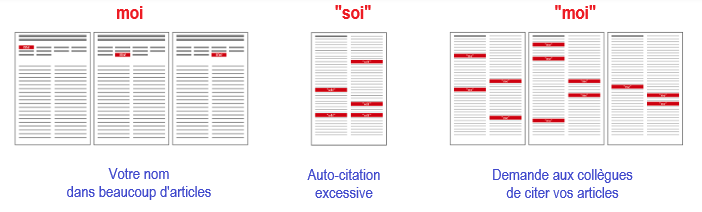

- Dans le cas des review mills, de « faux reviewers » réalisent des évaluations de piètre qualité et indiquent dans leur rapport d’évaluation que l’auteur devrait citer des articles bien précis (les leurs ou ceux de chercheurs ayant payé pour ce « service ») dans le but d’augmenter leur nombre de citations.

- En ce qui concerne les citation mills, des organisations manipulent et vendent ces citations pour augmenter l’impact de certains chercheurs. Pour insérer ces citations frauduleuses dans le circuit classique de la publication scientifique, ces organisations utilisent les review mills ou les paper mills.

Cette prédation de type « mills » dans la publication scientifique a des effets très négatifs sur différents plans :

- augmentation de la charge de travail des reviewers et des éditeurs des journaux scientifiques face à l’afflux d’articles ;

- augmentation du nombre d’articles rétractés ;

- perte de confiance dans la science de la part du grand public et des politiques ;

- difficulté croissante à se fier aux articles scientifiques d’un domaine que l’on ne maîtrise pas suite à l’infiltration de ces review mills dans le circuit classique de publication.

Les éditeurs commerciaux semblent avoir pris conscience du problème et certains ont entamé un gros travail de « nettoyage » mais la communauté scientifique doit aussi se saisir du problème. Ne serait-il pas temps d’arrêter cette course au nombre de publications sans prise en compte de leur qualité ?

Comment changer l’évaluation de la recherche pour une évaluation plus qualitative ?

La question centrale de l’évaluation de la recherche, des chercheurs, de leur carrière et de leurs projets reste l’une des résistances majeures à la transformation initiée par le mouvement de la science ouverte.

En effet, le paradigme « Publish or Perish » reste d’actualité et l’évaluation se base encore souvent sur l’utilisation d’indicateurs chiffrés controversés . Il est pourtant nécessaire que ce modèle évolue, car les maux qu’il engendre et dont il souffre sont connus : augmentation disproportionnée du nombre de publications scientifiques, usage de bibliothèque pirate, pas de valorisation des résultats négatifs, difficulté à trouver des reviewers, crise de qualité des études, augmentation des fraudes…

Pour ce qui est du cadre institutionnel, les organismes de recherche s’accordent depuis la signature de la DORA et du manifeste de Leiden sur la nécessité de faire évoluer l’évaluation des chercheurs, d’abandonner un certain nombre d’indicateurs et de prendre en compte une activité scientifique plus diverse que la simple publication des travaux.

Malgré tout, la représentation de l‘évaluation reste souvent dominée par le prestige des journaux, le nombre d’articles publiés et la valeur de l’indice h du chercheur. Ce n’est ni par stricte mauvaise volonté, ni par ignorance des problèmes actuels. Le problème structurel de l’aspect concurrentiel de la recherche rend la question de l’évaluation complexe.

Plusieurs propositions existent et un certain nombre d’entre elles rentrent petit à petit dans les usages des différents comités d’évaluation. Petit aperçu de nouvelles pratiques d’évaluation en lien avec la science ouverte :

- La promotion de l’utilisation des CV narratifs pour réduire l’emprise de l’évaluation quantitative au profit de l’évaluation qualitative, et l’expérimentation d’un « profil d’ouverture » (« openness profile ») sur ORCID ;

- Le recentrage des évaluations sur le contenu même des publications des chercheurs, malgré la lourdeur du travail qu’il induit ;

- L’encouragement des comités éditoriaux des revues et des éditeurs scientifiques à demander la communication des données et codes associés aux textes soumis, à les prendre en compte dans les procédures d’évaluation et à rendre publique leur politique sur les données et codes associés aux publications ;

- La valorisation de l’open peer-reviewing ;

- L’évaluation de l’utilisation ou du développement d’outils ou de logiciels libres ;

- La valorisation de compétences liées à la science ouverte, à la gestion du cycle de vie des données, au développement de code sources ;

- L’introduction dans le référentiel de compétences des chercheurs, enseignants-chercheurs, ingénieurs et techniciens de recherche d’un sous-ensemble de compétences en lien avec la science ouverte.

Les propositions existent, une évaluation plus qualitative est possible. Mais elle demandera, dans bien des cas, plus de moyens et de temps.

Illustration d’en-tête : Andrea pour Science infused

Source primaire : bibliothèque du CERIS, Institut Pasteur et ses publications sous licence CC BY 4.0

Science infuse est un service de presse en ligne agréé (n° 0329 X 94873) piloté par Citizen4Science, association à but non lucratif d’information et de médiation scientifique.

Non subventionné, notre média dépend entièrement de ses contributeurs pour continuer à informer, analyser, avec un angle souvent différent car farouchement indépendant. Pour nous soutenir, et soutenir la presse indépendante et sa pluralité, faites un don pour que notre section site d’actualité et d’analyse reste d’accès gratuit !

avec J’aime l’Info, partenaire de la presse en ligne indépendante