Loi Darcos sur l’IA et les contenus culturels : ce que dit vraiment le texte et ce que ses détracteurs taisent

Le Sénat a adopté à l’unanimité, le 8 avril 2026, une proposition de loi instaurant une présomption d’utilisation des contenus culturels par les fournisseurs d’intelligence artificielle. Un texte court, un article unique dans le Code de la propriété intellectuelle, mais aux implications considérables sur le plan probatoire, technologique et géopolitique.

La loi vient juste d’être adoptée par les sénateurs, et déjà, les clivages se forment. D »un côté les créateurs qui respirent, de l’autre les milieux tech qui s’alarment. La réalité, comme souvent, résiste aux deux visions et leurs récits polarisés.

Genèse et problématique traitée

Il faut remonter au rapport sénatorial du 9 juillet 2025 pour comprendre la genèse du texte. Signé par Agnès Evren, Laure Darcos et Pierre Ouzoulias, il s’intitule : « Création et IA : de la prédation au partage de la valeur« . il préconise une méthode graduelle en trois temps : concertation d’abord, loi en cas d’échec, et enfin taxation si nécessaire afin de régler la problématique que nous allons décrire maintenant.

Depuis l’essor de l’IA générative, les grands modèles de langage et de génération d’images, GPT, Gemini, Mistral et leurs semblables, s’entraînent sur des corpus colossaux de données issues du web : textes, romans, articles de presse, partitions, photographies, œuvres audiovisuelles. Ces œuvres sont, pour l’immense majorité d’entre elles, protégées par le droit d’auteur ou des droits voisins. Leurs créateurs n’ont, dans les faits, jamais donné leur consentement à cet usage.

Le problème n’est pas seulement moral. Il est probatoire, et c’est là qu’il devient juridiquement paralysant. En droit commun, c’est au demandeur, c’est-à-dire à l’auteur qui s’estime spolié, de prouver que son œuvre a bien été utilisée pour entraîner tel ou tel modèle. Or cette preuve est structurellement impossible à rapporter : les corpus d’entraînement ne sont jamais rendus publics, ils sont souvent partiellement détruits une fois le modèle formé, et la traçabilité d’une œuvre spécifique dans les centaines de milliards de paramètres d’un réseau de neurones n’existe tout simplement pas avec les outils actuels. Le créateur se retrouve donc dans la position absurde de devoir prouver ce qu’il ne peut pas voir, à l’intérieur d’une boîte noire à laquelle personne n’est tenu de lui donner.

C’est précisément cette violente asymétrie que la loi Darcos entend corriger. Son mécanisme central est un renversement de la charge de la preuve. Elle dispose ainsi que dorénavant, toute œuvre protégée sera présumée avoir été utilisée par le fournisseur d’un système d’IA, dès lors qu’un simple indice, issu du développement, du déploiement ou des résultats générés par le modèle, rend cette utilisation vraisemblable. C’est dès lors au fournisseur de démontrer qu’il n’a pas utilisé l’œuvre en question, ou qu’il a respecté les exigences légales applicables, notamment en ayant obtenu une licence ou en bénéficiant d’une exception légale de fouille de données.

En d’autres termes, la loi ne crée pas de nouveaux droits pour les auteurs. Elle leur donne enfin les moyens de faire valoir ceux qu’ils possèdent déjà.

La concertation a eu lieu. Engagée par Rachida Dati et Clara Chappaz entre dirigeants du secteur de l’IA et représentants des titulaires de droits, elle n’a abouti à aucun accord. Ce n’est donc pas un coup de force législatif imprévu qui voit le jour avec ce projet de loi, c’est l’étape deux d’une feuille de route annoncée, après l’échec constaté de la négociation volontaire. La proposition de loi a ainsi été déposée le 12 décembre 2025 par les trois auteurs du rapport. Il est à noter que le texte a d’abord été soumis au Conseil d’État en mars 2026 avant d’être examiné par les sénateurs. Il s’agit là d’une précaution constitutionnelle rare pour une proposition de loi, qui témoigne à la fois de la conscience de la fragilité juridique potentielle du dispositif et de la rigueur de ses auteurs.

Ce que fait vraiment la loi, ni plus ni moins

Le texte tient en un article unique, inséré à l’article L. 331-4-1 du Code de la propriété intellectuelle. Toute œuvre protégée par un droit d’auteur ou un droit voisin est présumée avoir été utilisée par le fournisseur d’un système d’IA, dès lors qu’un indice afférent au développement, au déploiement ou aux résultats générés « rend vraisemblable » cette utilisation.

Ce que cela signifie concrètement, c’est les fournisseurs de systèmes d’IA seraient présumés responsables dès lors qu’un indice rend vraisemblable une telle utilisation, et il leur appartiendrait alors de démontrer qu’ils n’ont pas utilisé de contenus protégés ou qu’ils ont respecté les exigences légales applicables.

Ce que cette loi ne signifie pas, il convient de le dire au regard de ses détracteurs qui l’affirment pourtant souvent : il ne s’agit pas d’une interdiction d’utiliser des contenus culturels pour entraîner un modèle, ni d’une présomption de contrefaçon automatique.

Le Conseil d’État a précisé qu’il s’agit d’une présomption d’usage et non d’une présomption d’atteinte. Ainsi, c’est au juge de qualifier l’éventuelle contrefaçon après constatation de l’utilisation. La présomption est par ailleurs simple, réfutable et non irréfragable.

Le Sénat a également précisé que les acteurs à qui la présomption est imputable sont tant les fournisseurs de modèles que les fournisseurs de systèmes d’IA afin de couvrir l’ensemble des acteurs de la chaîne de développement et de déploiement;

Le paradoxe technique que personne ne veut vraiment résoudre

C’est ici que l’esprit critique s’impose, comme toujours indépendamment des camps. Car la loi produit une asymétrie probatoire délibérée, et la question de sa praticabilité réelle mérite d’être posée, sans idéologie.

Comment un fournisseur de modèle d’IA réfutera-t-il cette présomption ? Les corpus d’entraînement des grands modèles sont rarement rendus publics, souvent partiellement détruits après la phase d’entraînement, et la traçabilité d’une œuvre spécifique dans les paramètres d’un réseau de neurones à des centaines de milliards de poids n’est tout simplement pas possible avec les outils actuels d’interprétabilité.

Le Conseil d’État a indiqué que la preuve contraire pourrait être apportée via une expertise respectant le secret des affaires. Cela étant dit, une expertise forensique sur un modèle de la taille de GPT-4 est-elle réaliste dans des délais judiciaires raisonnables ? L’état de l’art ne le permet pas.

Cette limite technique n’invalide pas le texte : elle en révèle la vraie nature. Comme l’explique la co-auteure de la loi Agnès Evren, l’objectif n’est pas de multiplier les procès, mais de créer un effet dissuasif pour inciter les acteurs de l’IA à abandonner certains comportements de prédation au profit de la négociation. La loi n’est pas un outil contentieux à proprement parler ; elle s’avère être un levier de négociation contractuelle. Elle rééquilibre le rapport de force à la table des discussions avant que le juge ne soit saisi.

Cette logique nouvelle, celle de la donnée comme actif stratégique dont l’usage doit être traçable, justifiable et potentiellement soumis à rémunération, pourrait créer les conditions favorables à l’émergence d’un marché de licences volontaires, notamment dans l’industrie musicale et audiovisuelle. C’est en ce sens que les effets économiques induits pourraient être plus significatifs que les effets juridiques directs.

Il reste une question que la loi ne résout pas, et que ses partisans préfèrent souvent esquiver : qui sont réellement les bénéficiaires ? Les grandes sociétés de gestion collective, SACEM, SAIF, SNE, disposent des moyens d’agir en justice et de négocier des accords de licence. Les créateurs indépendants, eux, n’ont ni la capacité de détecter l’usage de leurs œuvres, ni celle de financer un contentieux contre OpenAI ou Google. La présomption est un outil, mais un outil que seuls certains peuvent manier…

L’embarras de l’exécutif ou la France écartelée

Longtemps resté silencieux, le gouvernement est finalement sorti de son mutisme devant les sénateurs, s’en remettant à la « sagesse » de l’hémicycle sans prendre position pour ou contre le texte.

Cette posture de neutralité calculée trahit une contradiction structurelle. La France a fait du développement de l’IA une priorité nationale, et l’esprit qui a présidé au Sommet de Paris de février 2025 était clairement celui d’un pays voulant rivaliser avec les États-Unis et la Chine dans la course aux modèles. Imposer une présomption de responsabilité aux fournisseurs, c’est potentiellement fragiliser les acteurs européens, au premier rang desquels Mistral, face à des concurrents américains et chinois qui opèrent dans des juridictions sans contrainte comparable.

Cet argument est réel. Mais il est souvent agité de façon abusive par ceux qui voudraient en faire une raison de ne rien réguler du tout. Des comédiens de doublage français avaient obtenu début 2026 le retrait par la plateforme américaine Fish Audio de 47 modèles d’IA reproduisant leur voix sans consentement ni rémunération, mais ces succès judiciaires restent rares.C’est précisément cette rareté, structurelle et probatoire, qui légitime l’intervention législative.

Prétendre que cette loi serait « économiquement criminelle » ou mettrait en péril l’existence même de Mistral sur le sol français, c’est confondre un outil probatoire civil, limité et réfutable, avec une interdiction d’exercer. C’est agiter un épouvantail plutôt qu’analyser un texte. L’esprit critique commande d’interroger les uns et les autres sur leurs intérêts, y compris ceux qui s’expriment au nom de « l’innovation » sans jamais préciser de qui elle provient, et au bénéfice de qui elle s’exerce.

Articulation avec l’AI Act : le chaînon manquant

Le Conseil d’État a estimé que le législateur national était compétent pour créer cette présomption, considérant que la proposition de loi n’était contraire ni à la Constitution, ni au droit européen, sous réserve de quelques ajustements.

L’AI Act impose bien aux fournisseurs de modèles d’IA générative des obligations de politique de conformité au droit d’auteur et de transparence sur les données d’entraînement via des résumés publics. Mais il ne tranche pas lui-même tous les conflits de titularité ou d’usage. La loi Darcos comble donc un angle mort normatif réel : elle crée l’outil procédural que le règlement européen n’a pas voulu fournir.

Si la France se mobilise maintenant, c’est précisément parce que les négociations au niveau européen traînent ou n’aboutissent pas. Avec ce texte, la France se positionne en laboratoire normatif, et c’est délibéré. La présomption d’exploitation pourrait influencer les pratiques contractuelles à l’échelle européenne, comme le RGPD l’a fait pour les données personnelles. La comparaison est certes spéculative, mais elle n’est pas fantaisiste.

Ce qui reste ouvert : l’Assemblée nationale et la troisième étape

La proposition de loi a été transmise à l’Assemblée nationale. Son adoption par les députés n’est pas garantie, dans un contexte où l’exécutif ne s’est pas prononcé en sa faveur. La sénatrice Darcos espère une inscription à l’ordre du jour avant le 15 juillet.

Si la loi entre en vigueur, ses effets seront d’abord dissuasifs avant d’être contentieux, et comme nous l’avons vu, c’est voulu.

La troisième étape de la feuille de route sénatoriale, une taxation des usages d’IA à des fins culturelles, reste en réserve comme une menace implicite si la négociation n’aboutit pas même sous ce nouveau rapport de force.

Ce texte constitue une première étape dans la protection des auteurs face à la déferlante de l’IA, importante au regard des oppositions qu’elle a suscitées, mais encore timide pour assurer une réelle protection des créateurs. Car l’IA oui, mais avec éthique.

C’est peut-être là l’évaluation la plus honnête. Ni la révolution que les créateurs espèrent, ni le désastre industriel que les milieux tech annoncent. Un pas, prudent, dans un terrain encore largement inexploré, dont la vraie mesure se prendra non pas dans les prétoires, mais dans les salles de négociation où créateurs et plateformes vont, espérons-le, devoir se retrouver avec un rapport de force enfin modifié.

La proposition de loi n° 85 (2025-2026), adoptée par le Sénat le 8 avril 2026 à l’unanimité, est désormais transmise à l’Assemblée nationale pour examen.

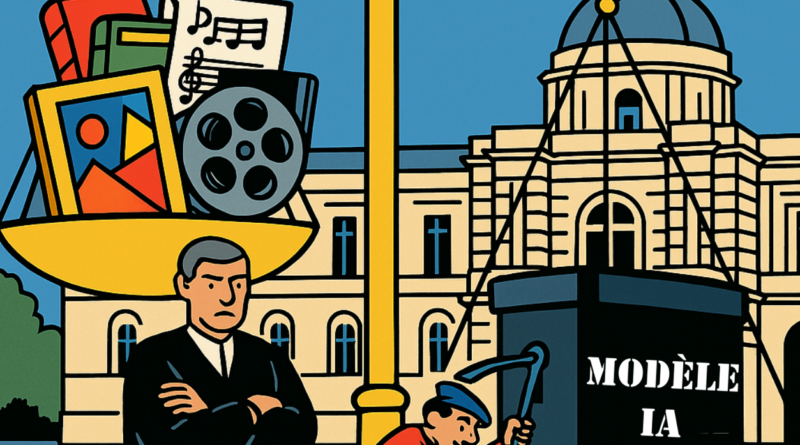

Image d’en-tête : Andrea pour Science infused

Cet article GRATUIT de journalisme indépendant à but non lucratif vous a intéressé ? Il a pour autant un coût ! Celui de journalistes professionnels rémunérés, celui de notre site internet et d’autres nécessaire au fonctionnement de la structure. Qui paie ? nos lecteurs pour garantir notre indépendance. Votre soutien est indispensable.

Science infuse est un service de presse en ligne agréé (n° 0329X94873) piloté par Citizen4Science, association à but non lucratif d’information et de médiation scientifique.

Notre média dépend entièrement de ses lecteur pour continuer à informer, analyser, avec un angle souvent différent car farouchement indépendant. Pour nous soutenir, et soutenir la presse indépendante et sa pluralité, faites un don pour que notre section presse reste d’accès gratuit, et abonnez-vous à la newsletter gratuite également !

ou via J’aime l’Info, partenaire de la presse en ligne indépendante