Le « factchecking », un remède pire que le mal ? une étude montre les risques lorsqu’il émane de groupes partisans

La vérification de faits, c’est bien mais encore faut-il qu’elle ne soit pas partisane pour être exacte et utile. Un problème récurrent souvent mis en avant dans ces colonnes qui relatent de temps à autre les péripéties de clans sectarisés qui instrumentalisent politiquement la science avec des fact-checkers autoproclamés. Le fact-checking peut renforcer les croyances et la mésinformation en cas d’engagement partisan, selon une nouvelle étude.

La désinformation est un problème majeur dont on a vu l’impact notamment à l’occasion de la crise sanitaire pour les questions de science et de santé. Dans ce cadre, vérifier les faits et les thèses avancées, c’est important. Cette activité doit être faite de façon pertinente et efficace pour ne pas entraîner l’effet inverse, à savoir alimenter des croyances et autre mésinformation. Un risque d’effet boomerang délétère du fact-checking existe-t-il ? Oui, et plus couramment qu’on ne le pense, révèle une étude pré-publiée (non encore validée par les pairs) en mai par des chercheurs en psychologie des université de Princeton, New-York et Pennsylvanie. Le problème ? les fact-checkers en clans concentrés sur le clan adverse, faisant abstraction de la mésinformation de leur propre clan.

L’impact délétère des réseaux sociaux et de ses influenceurs

La publication ne manque pas de planter le décor avec sur le devant de la scène les réseaux sociaux et ses 5 milliards d’utilisateurs. La grande majorité des personnes en Europe et aux États-Unis les utilisent comme source d’information (80 % pour les américains). On le sait, l’impact de la désinformation est important comme on l’a vu pour le Covid-19 avec par exemple l’hésitation vaccinale ou la croyance en des remèdes non éprouvés. On peut aussi parler du phénomène du climatoscepticisme.

C’est pourquoi le fact-checking comme riposte apparaît comme une solution évidente. Il y a aussi des techniques de prévention, comme l’inoculation pour former à la vigilance face à la désinformation, mais ce n’est pas le sujet du jour.

La publication rappelle, études scientifiques à l’appui, que les croyances peuvent avoir des motivations politiques, sociales ou économiques.

Notre commentaire ici : Et le « fact-checking » également, au-delà de la recherche de « vérité » annoncée !

La publication dont il est question aujourd’hui rappelle qu’il a déjà été démontré que le fact-checking ne fonctionne pas toujours : en matière politique, il est souvent moins efficace pour des raisons liées à des contenus à connotation morale ou émotionnelle. Malheureusement, sur les questions de science qui ne devraient pas l’être, son instrumentalisation politique, les questions de politique sanitaire et les oppositions tournant autour de personnes (exemple, l’affaire Raoult), l’émotion, l’intégrité des personnes ou la morale sont également très présentes actuellement en lien avec la crise santaire du Covid-19.

Il est question d’effets délétères de la vérification de faits via un « effet de vérité impliquée » et d' »effet de contre-feu » dans lesquels les personnes croient encore plus aux fausses informations à la suite de la vérification de faits.

Besoin d’identification à un clan

Ce besoin a été étudié scientifiquement par rapport aux croyances, et ce besoin s’avère nourrir ces croyances. La perception des personnes appartenant à des clans est certainement biaisée, lors de leur évaluation des informations mais aussi quand elles sont face à des vérifications d’information. Ces biais comprennent celui de la perception de l’émetteur : est-il de mon bord ? Est-ce que je m’identifie à lui ? (consciemment ou inconsciemment !). Si oui, la confiance sera plus importante, indépendamment du contenu et de la qualité de la vérification.

Conception de la recherche

Cette étude américaine porte sur le réseau social Twitter et sur la désinformation politique en tenant compte de l’appartenance partisane des sources d’information.

Les chercheurs ont examiné comment la croyance en la désinformation changeait lorsque la désinformation et les vérifications ultérieures des faits provenaient soit d’un membre du groupe politique, soit d’un membre d’un groupe externe, soit d’une source neutre. À la clé, l’évaluation de l’impact des corrections et de l’identité sociale sur les croyances, ainsi que celle des effets de contre-feu potentiels sur les corrections de groupes externes.

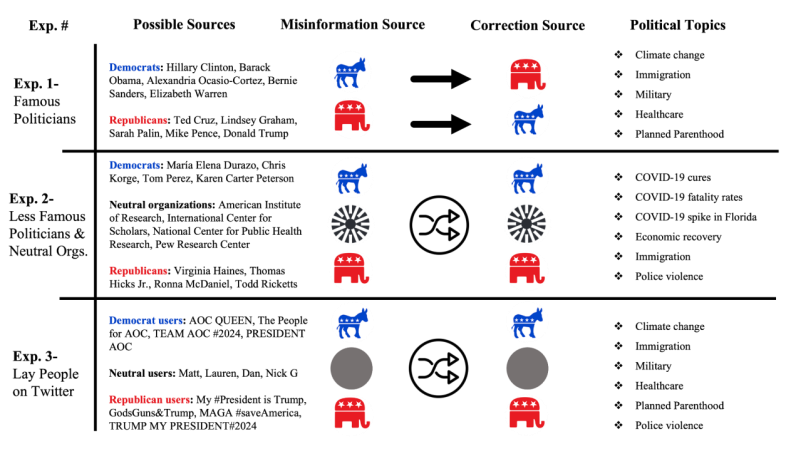

Les intervenants « politiques » ont été classés en fonction de la notoriété pour créer trois expérimentations : l’une avec des partisans (politiques) célèbres, une deuxième avec des partisans moins célèbres, et une troisième avec des utilisateurs Twitter neutres ou ‘naïfs » sur les sujets abordés, tous ces groupes pouvant émettre de la désinformation et des corrections.

Les chercheurs ont analysé pour chacun de ces groupes l’efficacité de leurs actions de correction de fausses informations.

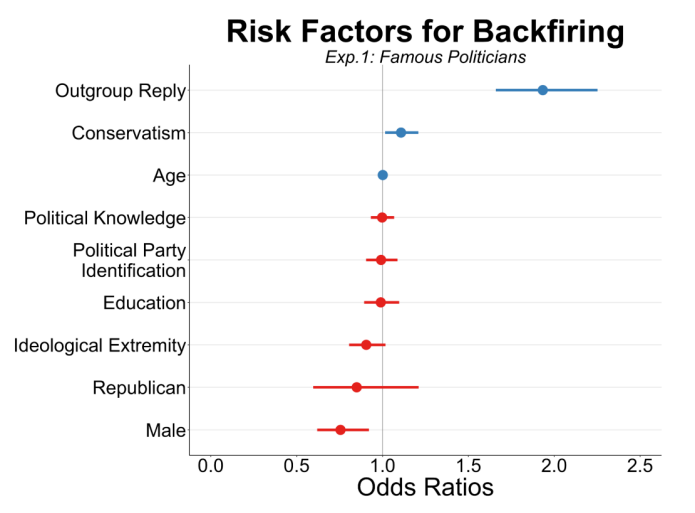

Les facteurs de risques de contre-feu via corrections ont également été étudiés, sur des critères démographiques (âge, éducation) ou l’identité politique.

La conception est simple : les chercheurs ont créé des tweets contenant de informations fausses qui avaient déjà été partagées par des politiques, recevant la réponse d’un autre politicien contenant la correction requise. L’idée était de mimer un échange réel comme on peut en voir sur les réseaux sociaux, cela permettant de voir la dynamique de réactions et de diffusion des informations, comme on le vit réellement sur ces réseaux.

Cette étude a été réalisé auprès de 1 217 personnes dans le cadre des 3 groupes d’expérience. Les personnes étaient tenus d’émettre un jugement sur les tweets proposés.

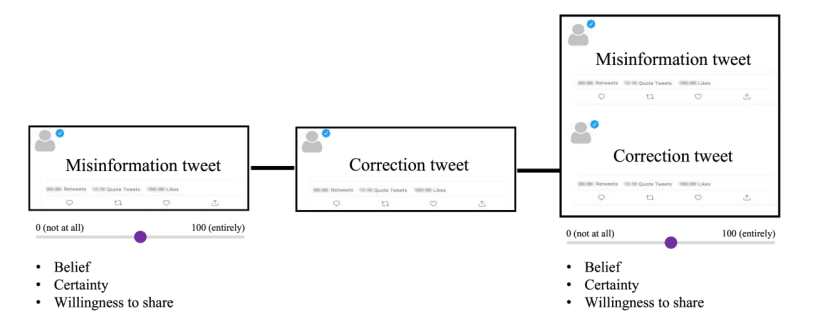

Cette figure de l’étude montre la procédure utilisée : les participants lisaient un premier tweet contenant des informations erronée et devaient indiquer dans quelle mesure ils croyaient le tweet, à quel point ils étaient sûrs de leur croyance, et s’ils étaient prêts à partager ce tweet, le tout sur une échelle de 0 à 100 points.

On leur montrait ensuite un tweet de correction provenant d’une source différente, puis les deux tweets côte à côte, et il leur était demandé d’évaluer à nouveau leur croyance, leur certitude et leur volonté de partager ce tweet.

Tableau des sources et sujets politiques dans chacune des 3 expériences (tableau de l’étude) :

Résultats

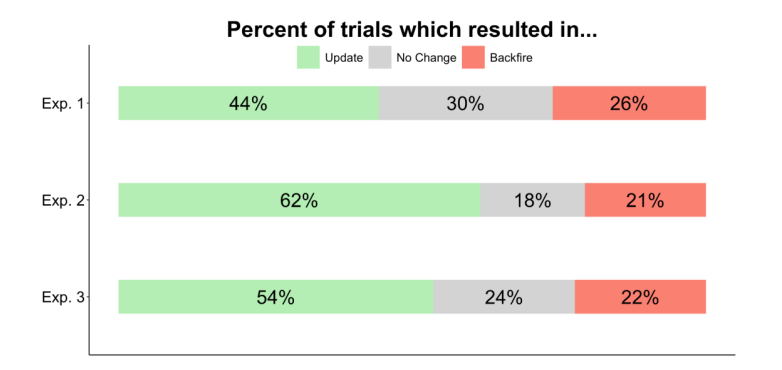

Ils pouvaient être de 3 ordres selon le jugement du participant : il mettait à jour son jugement grâce à la correction, il ne changeait pas d’avis, ou enfin il faisait contre-feu c’est–à dire renforcement de croyance erronée.

Cette figure extraite de l’étude montre que le contre-feu est un résultat qui survient de façon significative après le fact-checking (visionnage d’une réponse de correction à un post Twitter contenant de fausses informations).

Les chercheurs ont voulu savoir quels étaient les facteurs qui étaient impliqués dans un renforcement de croyance en réaction au fact-checking.

Voilà le résultat des investigations (ici pour le groupe 1) :

Dans la colonne de gauche on voit les caractéristiques des participants qui ont été évaluées par rapport à la réaction de renforcement de croyance suite au post de correction de fausses informations. Il en ressort que le facteur essentiel et significatif, c’est l’appartenance à un clan (ici politique). En d’autres termes : un fact-checking fait par un membre de clan identifié comme adverse par l’audience entraîne plus facilement l’effet inverse : rejet de la correction et renforcement de la croyance dans la fausse information.

De façon moins marqué, le caractère de clan ou partisan est également ce qui ressort comme première cause d’échec au fact-checking dans les groupes 2 (politiques ayant moins de notoriété) et 3 (personnes neutres).

Conclusions

Le constat essentiel de cette étude est que l’efficacité du fact-checking et de son éventuel échec dépend fortement de l’identité partisane de la source émettant la désinformation et la correction (même groupe d’appartenance politique, groupe opposé/extérieur, ou source neutre). Le risque d’effet inverse, soit renforcer la croyance erronée (contre-feu) est 5 fois plus puissant que l’effet de correction quand les sources font partie d’un clan opposé. Les chercheurs appellent cela l’effet de congruence partisane.

L’étude montre aussi que les partisans sont plus réceptifs aux corrections venant de leur groupe d’appartenance ou de sources neutres, que de groupes externes. Les corrections apportées par les membres d’un groupe politisé ont plus de chance (soit 52 %) de faire l’effet inverse de celui attendu avec des croyances qui s’ancrent encore plus dans la désinformation.

Les auteurs en déduisent que le factchecking est efficace en moyenne, mais ses effets sont limités en raison de la congruence de l’identité partisane, et qu’il se retourne parfois contre les personnes.

La conclusion de l’étude est qu’il s’avère que l’identité partisane peut être le moteur d’une mise à jour irrationnelle des croyances, amenant à leur renforcement.

« Le clanisme tue l’esprit critique »

C’est un crédo du compte de veille (@citizen4sci) de l’association Citizen4Science sur Twitter, qui se plaît à observer les clans en opposition sur les réseaux sociaux, et à évaluer la qualité des vérifications de faits par des factcheckers ou experts autoproclamés au rayon science et santé.

Désormais, il y a un support scientifique à ce crédo, l’étude présentée montrant que le clanisme et la partisanerie conduisent fortement à entraîner les personnes loin de la vérité des faits.

Une bonne raison pour ce compte de veille de rester hors des clans, mais qu’en tirer pour les clans ? Sans doute réfléchir à l’intérêt relatif de faire du factchecking quand on est dans un groupe militant, puisque l’on prêche essentiellement pour sa paroisse, et la nécessité d’un peu plus d’auto-critique et peut-être une idée intéressante : chasser la désinformation au sein de son propre clan, pour avoir une meilleure chance d’être entendu en son sein grâce à l’effet de congruence partisane. La partie n’est pas gagnée, si on se réfère à notre vieil édito de 2022 toujours d’actualité : Debunkers en bunker

La remarque vaut pour les journalistes du #factchecking, dont certains ont des comptes personnels « militants » sur les réseaux sociaux où ils affichent leurs opinions et leurs indignations, autant de perches pour les effets délétères de la congruence partisane du factchecking.

On peut conclure : faire du factchecking ou être militant et afficher ses opinions personnelles, il faut choisir.

Pour aller plus loin

Mise à jour 28/02/2023 – ajout de l’intervention de Kirby et du paragraphe final factchecking vs réseaux sociaux

Cet article GRATUIT de journalisme indépendant à but non lucratif vous a intéressé ? Il a pour autant un coût ! Celui de journalistes professionnels rémunérés, celui de notre site internet et d’autres nécessaire au fonctionnement de la structure. Qui paie ? nos lecteurs pour garantir notre ultra-indépendance. Votre soutien est indispensable.

Science infuse est un service de presse en ligne agréé (n° 0324 x 94873) piloté par Citizen4Science, association à but non lucratif d’information et de médiation scientifique.

Notre média dépend entièrement de ses lecteur pour continuer à informer, analyser, avec un angle souvent différent car farouchement indépendant. Pour nous soutenir, et soutenir la presse indépendante et sa pluralité, faites un don pour que notre section presse reste d’accès gratuit, et abonnez-vous à la newsletter gratuite également !

ou via J’aime l’Info, partenaire de la presse en ligne indépendante